https://t.co/rRVGSsZe9p

- M5 Paper Buddy 实现多会话状态监控与物理按键审批,提升 Claude Code 使用效率

- 利用成熟硬件生态(M5Stack)和 AI 辅助开发,个人开发者可快速构建 AI 物理交互原型

- AI 与物理世界交互的未来包括低门槛、模块化小硬件,而非仅限大公司主导的机器人等大设备

前几天,Anthropic 开源了 claude-desktop-buddy,用一块小屏幕显示 Claude Code 里 Buddy 的状态。

我看到后想:手头刚好有一块 M5Paper 墨水屏开发板,能不能把这个项目迁移过来?

结果做着做着,它变成了一个完全不同的东西:M5 Paper Buddy (

)。

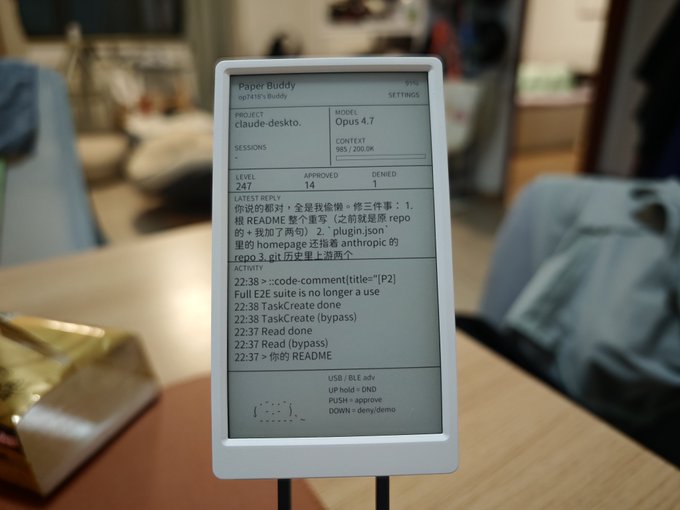

支持通过这个墨水屏设备蓝牙连接你的电脑,监控所有 Cluade Code 对话状态,还能快速审批对应的操作。

当你同时跑 3-4 个 Claude Code 窗口时,终端切来切去很烦。

你不知道哪个窗口在跑任务、哪个在等你审批、哪个已经闲置了。

而且 Claude Code 的 Permission System 需要你在终端里进行审批操作(bash 命令、文件编辑等)。

如果你离开电脑,就没法审批,任务就卡住了,除非你开自动模式。

终端擅长输入,不擅长当"状态面板"。

所以我想做一个独立的物理设备,专门用来监控 Claude Code 的状态、审批操作。

多会话 Dashboard

所有 Claude Code 窗口的状态显示在一个一个叫 M5 Paper 的墨水屏上:

每个会话显示:上下文使用量(45.8K / 200K)、模型(Opus 4.7)、项目名、分支、dirty 文件数。

触屏点击可以切换关注的会话,右侧显示该会话的详细信息(最近回复、活动日志)。

比如我在写 AIGC Weekly 时,同时跑 3 个项目。

看一眼就知道每个的进度,以及他们当前的状态。

M5Stack 是一个以模块化、积木式堆叠设计闻名的 ESP32 开源物联网硬件生态,而 M5Paper 则是该生态中一款专为低功耗信息看板打造的触控墨水屏极客终端。

物理按键审批

Claude Code 需要你在终端里进行审批操作。

M5 Paper Buddy 把审批搬到物理按键上:

- 全屏显示审批卡:tool 名 + 项目 + 完整内容(bash 命令原文 / edit 的 diff / write 的文件预览)

- PUSH 按钮同意,DOWN 按钮拒绝

- 审批记录在活动日志里留痕

物理按键更有仪式感。

尤其是 rm -rf、git push --force 这种高风险操作,按物理按钮会让你更慎重。

而且你可以看到完整的 diff 或命令内容,不用在终端里上下翻页。

蓝牙远程控制

通过蓝牙连接电脑,可以离开书桌审批操作。

比如你在沙发上看书,Claude 在跑测试,突然需要审批一个 bash 命令。

墨水屏在桌上亮了,拿起来按一下按钮就行。

配对后自动连接,断电保持状态。

硬件:M5Paper V1.1(ESP32 + 4.7 寸墨水屏 + 3 个物理按键 + GT911 电容触屏)

架构:Claude Code → Bridge Daemon(Python)→ M5Paper(蓝牙/USB)

协议:JSON 行分隔,向后兼容

中文支持:3.4MB TTF 字体,专门写了 codepoint-aware 的 wrapText

Anthropic 的 claude-desktop-buddy 是单会话、只显示状态、不支持审批。

主要用来显示 Buddy 的状态,是个好玩的玩具。

M5 Paper Buddy 支持多会话、触屏切换、物理按键审批、蓝牙远程控制。

增强了工具属性,而且利用了 M5 Paper 设备的大屏幕。

Anthropic 官方项目用的也是 M5Stack 硬件。

开源协议、开源代码,天天敌视国内涉及到硬件还得用国内生态。

这个项目本质上是"手机小组件的物理化"。

手机小组件只能"显示信息",不能"交互"。

你不能在小组件上按按钮、不能语音回复、不能触屏操作。

如果把它做成物理设备:

- 可以有按键和触屏

- "永远亮着"(墨水屏不耗电,断电保持显示)

- 不依赖手机屏幕,但和手机/电脑的 AI Agent 保持连接

形态可以很多样:磁吸在手机背面、挂在背包上(像挂件)、放在桌上(像桌面陪伴)

现在的 M5 Paper Buddy 是墨水屏 + 物理按键,但这只是第一步。

真正的"陪伴"应该是:无论你在哪里,它都能主动告诉你信息,然后你再回复。

不需要你盯着屏幕,不需要你走到设备前。

语音交互会是下一步。

但物理按键和语音不是替代关系,而是互补:

- 在书桌前,你需要看屏幕、按按钮(尤其是高风险操作)

- 离开书桌,你需要语音播报、语音回复

做这个项目的过程中,我发现了一些有意思的事

其实这些技术都不新。

墨水屏、蓝牙、触摸屏都是成熟技术,M5Stack、Arduino 这种模块化硬件也早就有了。

但为什么以前没人做这种东西?

我觉得是因为做硬件的和做 AI 的是两拨人。

做硬件的(苹果、三星)关心怎么卖更多手机,不关心“AI Agent 状态监控”。

做 AI 的(OpenAI、Anthropic)关心模型能力,不关心硬件形态。

但现在不一样了。

我做这个项目的时候,几乎没碰过硬件开发。

以前做硬件需要懂电路设计、画 PCB、读几百页的 datasheet。

现在 M5Stack 买回来就能用,官方提供完整的库和示例代码。

遇到问题,AI 可以帮你读 datasheet、写驱动、调试代码。

更重要的是深圳供应链。快速打样(1-2 周)、小批量量产、成本低(M5Paper ¥500)。

做 AI 的人可以很快出一个 Demo,去跟做硬件的人沟通交流。

再加上 3D 打印,你可以做出很精致的外壳。

社区有大量开源模型(Thingiverse、Printables)。

所以现在做 AI 的人可以做硬件了。

个人开发者可以先做出来,大公司还在立项。

前几天 OpenClaw(龙虾)火了

我觉得有几个原因:开源(所有人都能改)、可玩性(不只是“有用”,而是“好玩”)、低门槛(模块化 + AI 辅助开发)。

M5 Paper Buddy 也是这个思路:开源(GPL-3.0)、可玩性(桌面陪伴、物理审批的仪式感)、低门槛(两条命令:/buddy-install + /buddy-start)。

AI 和物理世界的交互,不应该只有机器人、自动驾驶这种“大硬件”。

这种模块化的小硬件,门槛低得多,可玩性也强。再搭配 3D 打印,会有不少玩法。

大公司肯定会做这种东西

但大公司慢。做硬件需要供应链、认证、渠道,从立项到上市至少 1-2 年。

以前他们没做,可能是因为比较迟钝,而且做硬件和做 AI 的是两拨人。

所以现在有个窗口期。个人开发者可以先做出来,开源社区可以先验证概念。

等大公司做出来,社区已经有成熟方案了。

物理化的 AI 触点

我觉得 AI 的下一步不只是更强的模型,还有物理世界的交互。

不只是机器人、自动驾驶这种“大硬件”,也包括桌面小设备、可穿戴设备、手机配件这种“小硬件”。

M5 Paper Buddy 是一个例子。把 AI 的状态和决策“物理化”,让手机小组件从屏幕里走出来。

你的桌上可能有一个“AI 监工”(墨水屏 + 按键)。

你的手机背面可能有一个“AI 小组件”(磁吸 + 触屏)。

你的背包上可能有一个“AI 挂件”(语音 + 震动)。

这些可能都不是大公司的产品,而是开源社区的创作。

GitHub 地址:

安装方式:

/buddy-install # 在 Claude Code 里运行 /buddy-start # 启动连接

如果你觉得这次的内容对你有帮助,可以帮我点个赞或者转发给需要的朋友。